일론 머스크와 얀 르쿤의 맞짱사태로 알아보는 AI 윤리

지난주 레터에서 예고했듯, 이번 레터는 AI가 절대 대체할 수 없는 일로 돈을 버는 방법에 대한 내용으로 채워보려 했습니다. 인간이 절대 로봇에게 자리를 내어줄 수 없는 영역이 뭐가 있을까 생각하다, 다소 뻔하지만 AI 윤리를 한번쯤 다뤄야겠다는 생각으로 이어졌죠. 그런데 웬걸, 감사하게도 27일, 일론 머스크와 메타의 AI 수석 과학자 얀 르쿤이 너무나 흥미로운 설전을 벌여주었습니다.

Join xAI if you can stand a boss who:

— Yann LeCun (@ylecun) May 27, 2024

- claims that what you are working on will be solved next year (no pressure).

- claims that what you are working on will kill everyone and must be stopped or paused (yay, vacation for 6 months!).

- claims to want a "maximally rigorous pursuit…

트위터 설전 원문

해석은 다음과 같습니다.

일론머스크 왈, "우주를 이해하는 우리의 미션을 믿는다면, 인기나 정치적 중립성에 관계없이 진실을 아주 철저히 추구해야 한다고 생각하는 xAI에 가입하세요."

얀 르쿤은 이걸 리트윗하며 아래와 같이 비꼬았습니다.

"다음과 같은 상사를 견딜 수 있다면 xAI에 가입하세요:

- 당신이 작업 중인 것이 내년에 해결될 것이라고 주장합니다 (압박 없음).

- 당신이 작업 중인 것이 모두를 죽일 것이며 중단되거나 일시 중지되어야 한다고 주장합니다 (야호, 6개월 휴가!).

- '극도로 철저한 진실 추구'를 원한다고 주장하지만 자신의 소셜 플랫폼에서 미친듯한 음모론을 퍼뜨립니다."

다른 사용자가 개입해 얀 르쿤의 이런 글이 비전문적이라며 뭐가 그렇게 맘에 안드는 거냐고 꼬집자 얀 르쿤은 이렇게 말했습니다. "나는 그의 자동차, 로켓, 태양광 패널, 그리고 위성 네트워크를 좋아합니다. 하지만 그의 복수심이 가득한 정치, 음모론, 그리고 과대 선전을 매우 싫어합니다."

논쟁은 머스크가 이 글에 응수하면서 격화되었습니다. (괄호에 있는 내용은 철저한 의역입니다.)

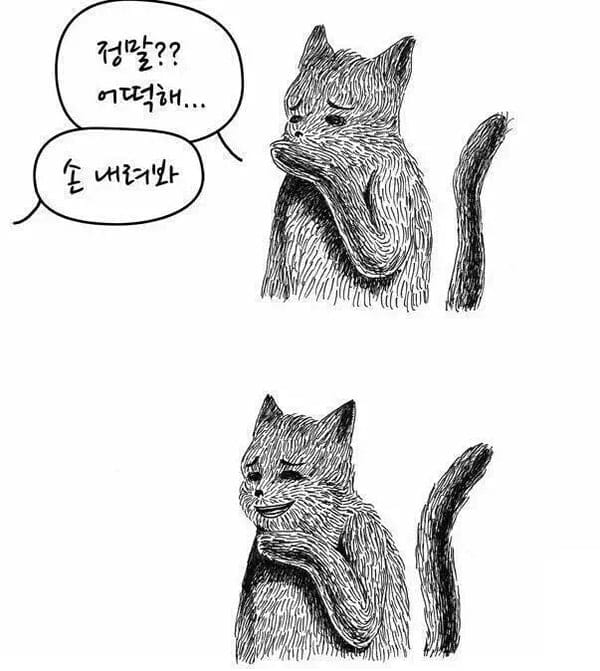

머스크: 지난 5년 동안 어떤 '과학'을 했나요? (그동안 과학 비슷한건 했냐?)

르쿤: 2022년 1월 이후 80편이 넘는 기술 논문을 발표했습니다. 당신은요? (넌 트위터나 했지?)

머스크: 겨우? 쉬엄쉬엄 하지 말고 더 노력해 보세요. (까불지 마라)

르쿤: 이제 마치 당신이 내 상사인 것처럼 행동하네요. (싫은데?)

머스크: 얀은 '그냥 명령에 따르는 중' (사장도 아닌 게)

르쿤: 연구가 어떻게 작동하는지 이해하지 못하는 것 같네요. (니가 연구에 대해서 몰알아)

그냥 돈 많은 아저씨 둘이 별 것도 아닌 걸로 싸우는 것 같지만, 이 싸움에도 배경은 있었습니다. 얀 르쿤과 머스크는 약 한달 전, 파이낸셜 타임즈와의 인터뷰에서 AI가 인간을 능가할 수 있냐 없냐로 한차례 의견이 갈린 적이 있거든요.

일론 머스크는 대표적인 "AI 무서우니까 그만 개발해" 파였습니다. 비슷한 인물로는 워렌 버핏이 있죠. 인간보다 똑똑해 지거나, 인간에게 해를 끼칠 거라는 입장입니다.

반면 얀 르쿤은 대표적인 "AI 안 무서워" 파죠. 인간의 언어를 하니 똑똑해 보일 뿐, AI는 구조적으로 인간을 뛰어넘거나 인간보다 더 똑똑해질 수 없다는 겁니다. 얀 르쿤에 따르면 AI는 논리를 이해하지 못하며, 물리적 세계에 대한 이해가 부족하고, 장기 기억이 없으며, 잘 추론할 수 없고, 복잡한 계획을 세울 수 없습니다.

그런데, 소식 들으셨나요? 머스크가 xAI를 설립해 8조원 가량의 투자를 받았다는 얘기요. 투자금으로는 GPU 10만 개를 매입해 세계 최대 규모 데이터센터 '컴퓨터 기가팩토리'를 구축할 거구요. 이 시설로는 본인들이 만든 LLM ‘그록3’를 훈련시킬 것이라고 합니다. 업계에서는 머스크 CEO가 xAI를 통해 범용인공지능(AGI) 개발에 뛰어들 것으로 전망하고 있죠.

너무 이상하지 않나요? AI 무서우니까 그만 개발해야 하는데, 8조원 투자 받아서 AGI 만들고 데이터 센터 만들면.. AI 무서우니까 "내가" 개발해야 한다는 얘기였을까요?

아마도 얀 르쿤은 이런 지점이 다소 황당하고 화도 났을 겁니다. 오픈소스를 지향하는 대표적 기업인 메타의 입장에서 봐도 그렇죠. 서로 공유하고 더 나은 모델을 만들고, 독점과 규제에서 멀어지고 싶은 본인들의 이상향에 비춰보면 머스크는 너무나 이기적인 사람입니다. 인간을 위한 AI는 나밖에 못 만든다니, 얼마나 오만한가요? 근데 또 그게 참 머스크 답기도 하고요. 심지어 머스크는 트위터 셀럽이라 이런 본인의 생각을 사회에 순식간에 확산시킬 수 있는 능력도 갖추고 있죠. 얀 르쿤의 조롱 뒤에 숨겨진 생각이 느껴지시나요?

AI 윤리는 어떻게 보면 이런 대립에서 조금씩 발전해 나가고 있다고 볼 수 있습니다. 인간을 위한 AI는 무엇이고, 그걸 위해 개발의 속도를 임의로 조절할 가치가 있는가? 인간을 위한 AI를 만드려면 개발자와 사업자는 어떤 가치관을 가져야 하는가? 같은 질문을 업계에서 던지고 있는 것이니까요. 그리고 아주 명확하게 저런 질문들은 AI가 답을 내릴수도, 내려서도 안되는 문제입니다. AI 윤리에 대한 연구와 논의가 좀 더 발전해 나간다면, 대 AI 시대에서도 인간의 영역과 고유성이 조금 더 명확해질 수 있지 않을까 기대해 보며 이번주 레터 마치겠습니다.